人工智能數(shù)學(xué)基礎(chǔ)與軟件開(kāi)發(fā) 構(gòu)建智能系統(tǒng)的雙翼

人工智能(AI)作為當(dāng)今科技領(lǐng)域的核心驅(qū)動(dòng)力,其背后是堅(jiān)實(shí)的數(shù)學(xué)基礎(chǔ)與高效的軟件開(kāi)發(fā)能力的深度融合。這兩者如同鳥(niǎo)之雙翼、車(chē)之兩輪,共同支撐著智能系統(tǒng)的設(shè)計(jì)、實(shí)現(xiàn)與優(yōu)化。理解并掌握這一結(jié)合點(diǎn),是進(jìn)入AI領(lǐng)域并開(kāi)發(fā)出可靠、高效智能應(yīng)用的關(guān)鍵。

一、人工智能的數(shù)學(xué)基石

人工智能并非憑空產(chǎn)生,其智能行為源于對(duì)現(xiàn)實(shí)世界的數(shù)學(xué)建模與計(jì)算。核心數(shù)學(xué)基礎(chǔ)主要包括:

- 線性代數(shù):AI的“語(yǔ)言”。從神經(jīng)網(wǎng)絡(luò)中權(quán)重的矩陣表示,到圖像、文本等數(shù)據(jù)的向量化處理,線性代數(shù)提供了描述和處理高維數(shù)據(jù)的基本框架。特征值、特征向量、奇異值分解等概念是降維(如PCA)和模型理解的核心。

- 微積分與優(yōu)化理論:AI的“學(xué)習(xí)引擎”。神經(jīng)網(wǎng)絡(luò)的訓(xùn)練本質(zhì)是一個(gè)大規(guī)模優(yōu)化問(wèn)題。梯度下降及其變體(如Adam、SGD)依賴于偏導(dǎo)數(shù)(微積分)來(lái)尋找損失函數(shù)的最小值,從而更新模型參數(shù)。理解導(dǎo)數(shù)、鏈?zhǔn)椒▌t和凸優(yōu)化是理解深度學(xué)習(xí)如何“學(xué)習(xí)”的根本。

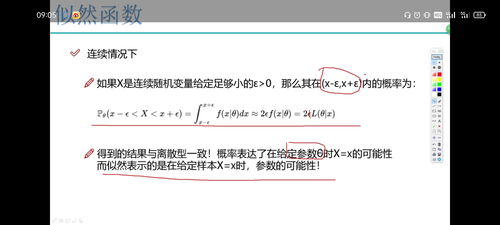

- 概率論與統(tǒng)計(jì)學(xué):AI的“不確定性管理者”。現(xiàn)實(shí)世界充滿噪聲和不確定性。概率論為機(jī)器學(xué)習(xí)算法(如樸素貝葉斯、隱馬爾可夫模型、高斯過(guò)程)提供了理論基礎(chǔ)。統(tǒng)計(jì)學(xué)中的估計(jì)、假設(shè)檢驗(yàn)和置信區(qū)間則用于評(píng)估模型性能、進(jìn)行A/B測(cè)試和理解數(shù)據(jù)的分布,是模型可靠性的保障。

- 信息論:AI的“量化工具”。它提供了度量信息、熵和互信息的數(shù)學(xué)方法,在特征選擇、決策樹(shù)構(gòu)建(如ID3算法使用信息增益)以及模型壓縮中發(fā)揮著重要作用。

二、人工智能基礎(chǔ)軟件開(kāi)發(fā):從理論到實(shí)踐

有了數(shù)學(xué)理論,需要通過(guò)軟件開(kāi)發(fā)將其轉(zhuǎn)化為可運(yùn)行的系統(tǒng)。這一過(guò)程涉及多個(gè)層次:

- 核心編程語(yǔ)言與范式:

- Python:當(dāng)前AI開(kāi)發(fā)的首選語(yǔ)言,得益于其簡(jiǎn)潔語(yǔ)法、豐富的庫(kù)生態(tài)(如NumPy, Pandas, Matplotlib)和強(qiáng)大的社區(qū)支持。

- C++/CUDA:用于追求極致性能的場(chǎng)景,如深度學(xué)習(xí)框架底層算子、高性能計(jì)算(HPC)和邊緣設(shè)備部署。

- 軟件開(kāi)發(fā)思想:模塊化設(shè)計(jì)、面向?qū)ο缶幊蹋∣OP)、函數(shù)式編程(FP)等,能幫助構(gòu)建可維護(hù)、可擴(kuò)展的AI代碼庫(kù)。

- 主流開(kāi)發(fā)框架與工具鏈:

- 深度學(xué)習(xí)框架:TensorFlow、PyTorch已成為行業(yè)標(biāo)準(zhǔn)。PyTorch以其動(dòng)態(tài)計(jì)算圖和易用性深受研究人員喜愛(ài);TensorFlow則在生產(chǎn)部署和移動(dòng)端支持上具有優(yōu)勢(shì)。它們將復(fù)雜的數(shù)學(xué)計(jì)算(如自動(dòng)微分)封裝成簡(jiǎn)潔的API。

- 數(shù)據(jù)處理與管道:使用Pandas、SQL進(jìn)行數(shù)據(jù)清洗與處理;利用TensorFlow Data API或PyTorch DataLoader構(gòu)建高效的數(shù)據(jù)加載管道。

- 實(shí)驗(yàn)管理與部署:MLflow、Weights & Biases用于跟蹤實(shí)驗(yàn)、記錄參數(shù)和指標(biāo);Docker、Kubernetes用于容器化部署和規(guī)模化服務(wù);TensorRT、OpenVINO等用于模型優(yōu)化與特定硬件加速。

- 軟件開(kāi)發(fā)全流程:

- 問(wèn)題定義與數(shù)據(jù)準(zhǔn)備:將業(yè)務(wù)問(wèn)題轉(zhuǎn)化為機(jī)器學(xué)習(xí)任務(wù),并收集、清洗、標(biāo)注數(shù)據(jù)。

- 模型原型與實(shí)驗(yàn):利用框架快速搭建模型,進(jìn)行訓(xùn)練、驗(yàn)證和調(diào)參。此階段需要扎實(shí)的數(shù)學(xué)知識(shí)來(lái)理解模型行為并診斷問(wèn)題(如梯度消失、過(guò)擬合)。

- 工程化實(shí)現(xiàn):將實(shí)驗(yàn)代碼重構(gòu)為健壯、可測(cè)試的工程代碼,編寫(xiě)單元測(cè)試和集成測(cè)試。

- 部署與監(jiān)控:將模型部署為API服務(wù)或嵌入到應(yīng)用程序中,并建立監(jiān)控系統(tǒng)以跟蹤模型在生產(chǎn)環(huán)境中的性能衰減和數(shù)據(jù)分布變化。

三、數(shù)學(xué)與軟件開(kāi)發(fā)的協(xié)同效應(yīng)

成功的AI開(kāi)發(fā)者或工程師,是能夠在這兩個(gè)領(lǐng)域自由穿梭的“雙語(yǔ)者”。

- 數(shù)學(xué)指導(dǎo)開(kāi)發(fā):理解反向傳播的數(shù)學(xué)原理,能幫助開(kāi)發(fā)者在自定義神經(jīng)網(wǎng)絡(luò)層或損失函數(shù)時(shí)避免錯(cuò)誤;理解概率分布,能更合理地設(shè)計(jì)數(shù)據(jù)增強(qiáng)策略或評(píng)估模型的不確定性。

- 開(kāi)發(fā)驗(yàn)證與深化數(shù)學(xué)理解:通過(guò)編程實(shí)現(xiàn)一個(gè)算法(如從零開(kāi)始寫(xiě)一個(gè)梯度下降),是理解其數(shù)學(xué)本質(zhì)的最佳途徑。軟件工具(如可視化)也讓抽象的數(shù)學(xué)概念(如高維空間中的向量變換)變得直觀。

- 解決復(fù)雜問(wèn)題的能力:面對(duì)一個(gè)全新的AI問(wèn)題(如時(shí)間序列預(yù)測(cè)、圖神經(jīng)網(wǎng)絡(luò)應(yīng)用),扎實(shí)的數(shù)學(xué)基礎(chǔ)能幫助快速定位核心數(shù)學(xué)模型,而嫻熟的軟件開(kāi)發(fā)能力則能高效地將想法落地實(shí)現(xiàn)并進(jìn)行迭代優(yōu)化。

###

人工智能的數(shù)學(xué)基礎(chǔ)與軟件開(kāi)發(fā),一者向內(nèi)深挖原理,一者向外實(shí)現(xiàn)價(jià)值。二者并非割裂,而是相輔相成。對(duì)于初學(xué)者,建議采取“螺旋式上升”策略:學(xué)習(xí)基礎(chǔ)數(shù)學(xué)概念后,立即通過(guò)編程實(shí)踐(如用NumPy實(shí)現(xiàn)矩陣運(yùn)算,用PyTorch訓(xùn)練一個(gè)簡(jiǎn)單網(wǎng)絡(luò))來(lái)鞏固;在實(shí)踐中遇到瓶頸(如模型不收斂),再回頭深入研究相關(guān)的數(shù)學(xué)理論。如此循環(huán),逐步構(gòu)建起既深刻又實(shí)用的AI能力體系,最終能夠獨(dú)立設(shè)計(jì)、實(shí)現(xiàn)并部署解決實(shí)際問(wèn)題的智能系統(tǒng)。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://m.xiangshuiwan.cn/product/69.html

更新時(shí)間:2026-04-28 18:50:15